موظفو OpenAI يحذرون من مخاطر الذكاء الاصطناعي على البشرية

موظفون حاليون وسابقون في شركة OpenAI، المعروفة بتطوير ChatGPT، قد أطلقوا تحذيرًا بشأن مخاطر الذكاء الاصطناعي المتقدم. في رسالة مفتوحة نُشرت يوم 4 يونيو، تناولت المخاطر المحتملة لهذه التقنية على البشرية، مشيرة إلى فجوات اجتماعية وتلاعب بالمعلومات يمكن أن تؤدّي إلى فقدان السيطرة على الأنظمة الذكية، مما يهدد بانقراض الإنسانية.

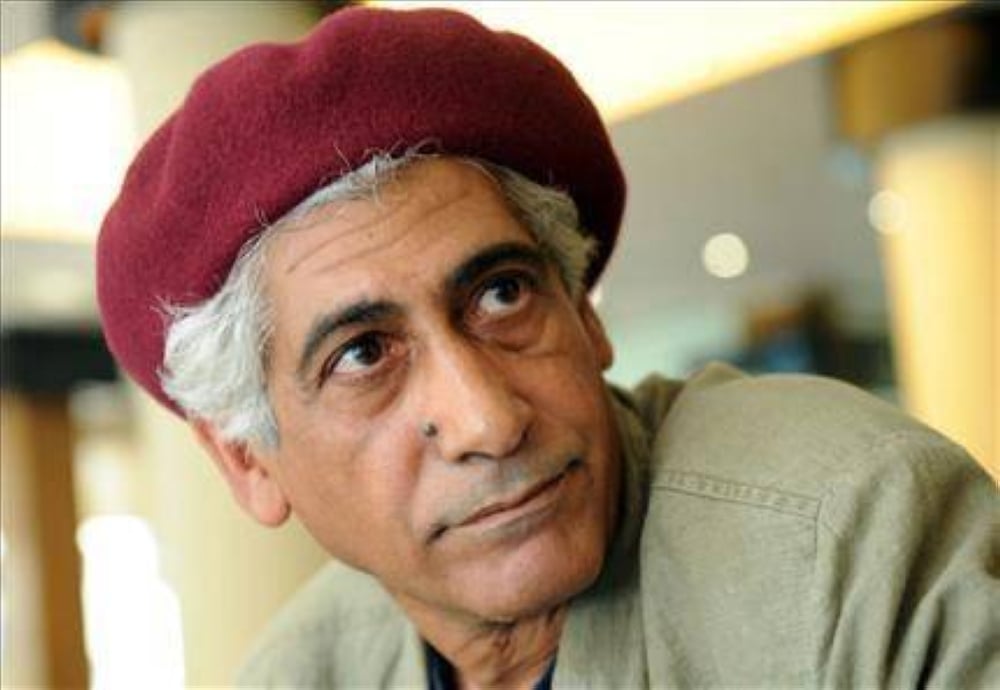

تحدث نيل ناندا، من DeepMind وموقّع على الرسالة، عن أهمية ضرورة تسليط الضوء على الفوائد والمخاطر المحتملة للذكاء الاصطناعي. وأكدت الرسالة نقصًا في التنظيم والمساءلة لشركات الذكاء الاصطناعي، مؤكدة على ضرورة وجود رقابة حكومية فعّالة.

تطرقت الرسالة أيضًا إلى مشاكل شفافية الشركات في مشاركة معلوماتها، وشهدت OpenAI تغييرات مثيرة للجدل، كما فكّكت فريق دراسة التهديدات طويلة الأمد المرتبطة بالذكاء الاصطناعي. تثير هذه التطورات تساؤلات حول مستقبل الذكاء الاصطناعي وكيفية التعامل مع التحديات الناشئة.