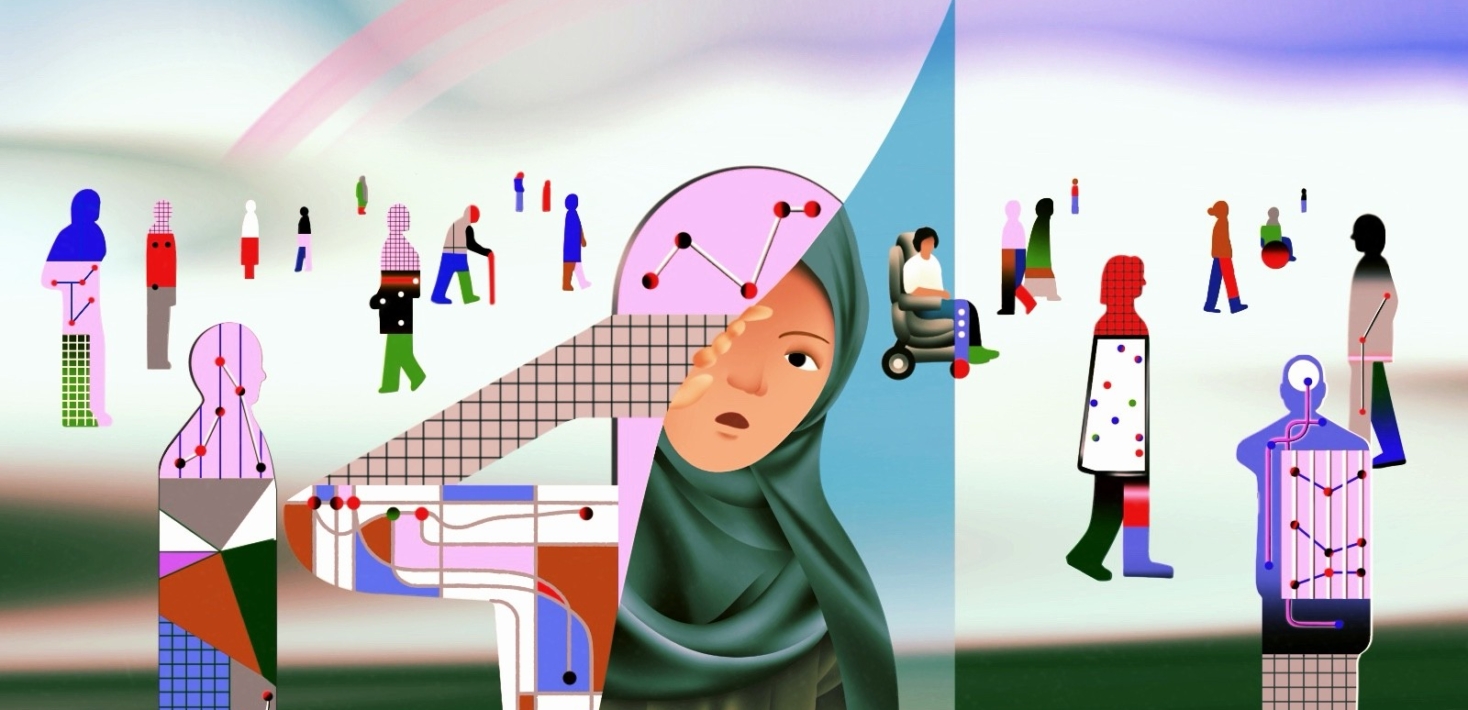

أثار تقرير حديث من منظمة العفو الدولية مخاوف بشأن استخدام الدنمارك لأدوات الذكاء الاصطناعي في نظام الرعاية الاجتماعية. النظام، الذي يديره “أودبيتالينغ دنمارك”، مصمم لكشف الاحتيال ولكنه يواجه اتهامات بتعزيز المراقبة الجماعية والتمييز، خصوصًا ضد الفئات المهمشة مثل ذوي الإعاقة والمهاجرين.

التقرير بعنوان “العدالة المبرمجة” يسلط الضوء على كيفية تجميع النظام لبيانات شخصية واسعة، ما يؤدي إلى انتهاكات للخصوصية ويتسبب في مناخ من الخوف بين المستفيدين. ويشير إلى أن استهداف الفئات المعرضة للخطر يعكس تقويضًا للكرامة الإنسانية والحقوق الأساسية.

استخدام الذكاء الاصطناعي لأتمتة اكتشاف الاحتيال أصبح موضوع النقاش داخل الاتحاد الأوروبي، حيث تعبر المنظمات الحقوقية عن قلقها من تداعيات جمع البيانات بشكل موسع دون موافقة الأفراد. الخوارزميات المستخدمة قد تؤدي إلى نتائج خاطئة، مما يعزز الفوارق الاجتماعية.

تمثل الخوارزميات المستخدمة في النظام تهديدًا خاصًا، مثل خوارزمية “حقًا أعزب”، التي قد تؤثر بشكل غير متناسب على الأفراد ذوي الاحتياجات الخاصة والعائلات ذات الهيكليات المتعددة الأجيال. علاوة على ذلك، تستهدف خوارزمية “النموذج الخارجي” الأفراد الذين يرتبطون بدول خارج المنطقة الأوروبية، ما يثير مخاوف بشأن التنميط العرقي.

منظمة العفو دعت الحكومة إلى إعادة النظر في كيفية استخدام الذكاء الاصطناعي والتأكد من توافق الأنظمة مع حقوق الإنسان. الحاجة إلى الشفافية والرقابة تزداد مع استمرار انتشار التكنولوجيا، مما يجعل من الضروري أن تضع الدنمارك و الاتحاد الأوروبي حماية حقوق الإنسان في مركز أولوياتهم.

عدد المصادر التي تم تحليلها: 6

المصدر الرئيسي : رافي برازي

post-id: 892d7c7b-555e-40f2-8224-ae0f5d5b7e89