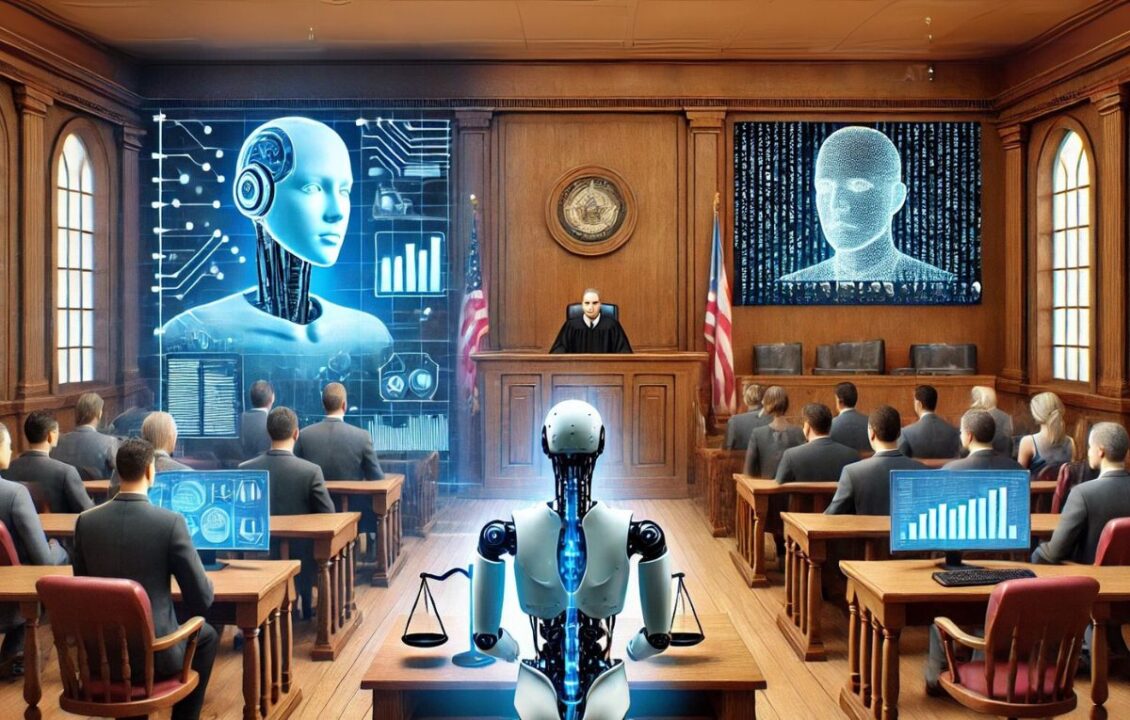

استخدام الذكاء الاصطناعي في العدالة الجنائية: فرص وتحديات

أصبح الذكاء الاصطناعي قوة مؤثرة في مجال العدالة الجنائية، مما يعكس إمكانياته في تحسين الكفاءة عمليات إنفاذ القانون، لكنه أيضًا يأتي مع مخاطر جدية. التهديدات تتزايد كتحسين تقنيات التزييف العميق، حيث يمكن أن تُستخدم الصور والمقاطع المزيفة كأدلة ضد الأفراد، مما يفتح الباب أمام احتمال انعدام العدالة.

الأمل يكمن في استخدام الذكاء الاصطناعي لتعزيز الإجراءات القضائية، من خلال أنظمة التعرف على الوجه والتحليل الاجتماعي، لكن هذه التقنية تواجه انتقادات بسبب مخاطر التحيز والتمييز. الخوارزميات، التي تعتمد على بيانات قد تتضمن انحيازات موجودة، يمكن أن تؤدي إلى قرارات غير عادلة. ويثير هذا الأمر تساؤلات حول مَن يتحمل مسؤولية الأخطاء المرتكبة.

من جهة أخرى، القضايا المتعلقة بمصداقية الأدلة الرقميّة تتزايد أيضًا. تطور التقنيات يؤثر على قدرة القضاة والمحامين في تمام تقدير الدلائل المقدمة أثناء المحاكمة. كما أن استخدام الذكاء الاصطناعي في تقييم المخاطر قد يجبر الأفراد على مواجهة قرارات مصيرية دون فهم الأسباب وراءها، مما يعزز الشعور بعدم العدل.

تتطلب هذه التحديات وضع أطر قانونية وأخلاقية صارمة لضمان الاستخدام المسؤول للذكاء الاصطناعي. يُلقي قانون الذكاء الاصطناعي في الاتحاد الأوروبي الضوء على ضرورة حماية البيانات ومنع التمييز، مما يدعو الدول الأخرى للاقتداء به. لتحقيق العدالة والمساواة، يجب أن يكون الذكاء الاصطناعي أداة لخدمة الصالح العام، وليس وسيلة لتعزيز الظلم.

عدد المصادر التي تم تحليلها: 4

المصدر الرئيسي : aitnews.com أمينة حسني

post-id: d5e8c608-ca2e-43e0-a530-f38e710d8627