أصبح الذكاء الاصطناعي الآن جزءًا أساسيًا في حياتنا اليومية، متجاوزًا كونه مجرد أداة مساعدة ليصبح عاملاً مهماً في تشكيل وعي الإنسان وسلوك المجتمعات. لم يعد الأمر مقتصرًا على تعاملنا مع آلات تؤدي أوامرنا فحسب، بل أصبح لدينا “عقول رقمية” تستطيع التفكير والتعلم والتحليل، مما يؤثر على قراراتنا وخصوصياتنا دون أن نشعر بذلك.

لكن السؤال يبقى، كيف أصبح الذكاء الاصطناعي شريكًا في تشكيل الوعي البشري، وما هي المخاطر المحتملة الناتجة عن تأثيره على قراراتنا وخصوصياتنا؟

في هذا السياق، يوضح الدكتور محمد محسن رمضان، رئيس وحدة الذكاء الاصطناعي والأمن السيبراني، أن التكنولوجيا كانت تقتصر على تسهيل العمل وزيادة سرعة الأداء، ولكن الذكاء الاصطناعي الآن أصبح شريكًا معرفيًا ينتج الأفكار، ويكتب المقالات، ويحلل البيانات، ويقترح الحلول.

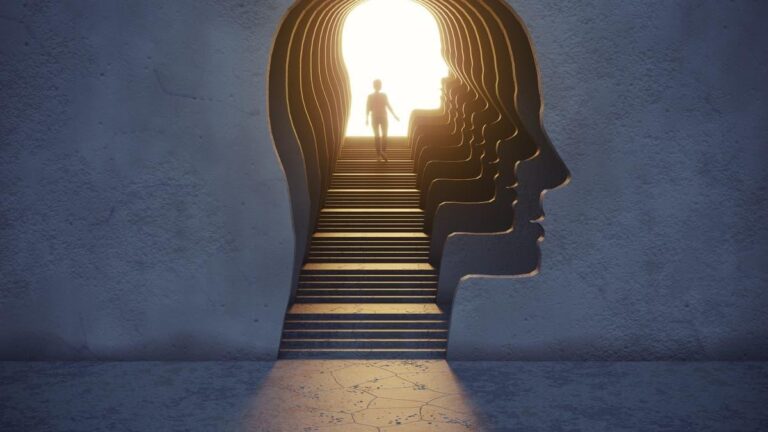

إعادة برمجة للعقل الإنساني

تحدث الدكتور رمضان عن أن هذا التحول يستدعي سؤالاً جوهريًا: هل الأفكار التي نحصل عليها اليوم ناتجة عن وعينا الذاتي أم أنها مستمدة من خوارزميات تقترح ما يجب علينا مشاهدته وقراءته؟ الوعي الجماعي للمجتمعات لم يعد يتشكّل فقط عبر الإعلام التقليدي أو المؤسسات الثقافية، بل أصبح يتشكل من خلال منصات رقمية تستخدم الذكاء الاصطناعي لتخصيص المحتوى، مما يسهم في رسم خريطة ذهنية رقمية لكل فرد.

وأشار إلى أن هذه الخريطة تغذي خوارزميات التوصية التي تحدد المحتوى الذي يراه الفرد على منصات مثل فيسبوك وتيك توك ويوتيوب، مما يؤدي إلى تكوين “فقاعات وعي رقمية” تفقد التنوع وتؤدي إلى انغلاق مجتمعات معرفية. هذا ليس فقط ثورة معلوماتية، ولكنه إعادة برمجة للعقل البشري.

وتطرق رمضان إلى تقنيات الذكاء الاصطناعي التوليدي، مشيرًا إلى أنها تتيح إمكانية إنتاج محتوى من صور وفيديوهات وأصوات واقعية لشخصيات لم تفعل أو تقم بما تم عرضه، مما يجعلنا ندخل في عصر “تزييف الوعي” حيث لا تعود الحقيقة مرتبطة بما حدث بالفعل ولكن بما تقنعك به الخوارزمية أنه حدث. وهذه الخطورة لا تتعلق فقط بالتضليل السياسي أو الإعلامي، بل بإدخال الإنسان إلى حالة من التلقي السلبي وفقدان قدرته على التمييز بين الحقيقي والمزيف.

من جهته، أكد اللواء طارق عطية، مساعد أول وزير الداخلية المصري الأسبق، أن المدرسة والجامعة ووسائل الإعلام لم تعد المصادر الوحيدة للمعرفة. فالذكاء الاصطناعي يستطيع تقديم دروس، وشرح مفاهيم، وكتابة قصص، وإنتاج الأخبار. لكن التحدي ليس في القدرات التقنية ولكن في الحياد المعرفي. كيف نضمن أن المعلومات التي ينتجها الذكاء الاصطناعي خالية من التحيزات؟ من الذي سيراقب المحتوى الذي يخرجه نظام يعتمد على بيانات بشرية مليئة بالأخطاء والمغالطات؟ الأمور تقترب من مرحلة يصبح فيها الإعلام والتعليم محسوبين على خوارزميات غير خاضعة للرقابة التامة.

كما أشار عطية إلى أن نقاش الوعي لدى الآلات قد أصبح واقعًا ملموسًا، فأنظمة الذكاء الاصطناعي قادرة الآن على تحليل المشاعر وتقييم المواقف بل وكتابة نصوص تعبر عن مشاعر مشابهة للبشر. ولكن يبقى السؤال الأعمق: هل حقيقة تمتلك هذه الأنظمة وعيًا حقيقيًا، أم أنها فقط تحاكي الوعي؟ وهل سيتحول يومًا ما اتخاذ قراراتنا الأخلاقية والسياسية إلى نتاج حتمي للخوارزميات بدلاً من كونها تعبيرًا عن القيم الإنسانية؟

خطر التلاعب بالعقول

أضاف عطية أنه بينما يحمي الأمن السيبراني الأنظمة من الاختراق، فإن الأمن الفكري بات يمثل خط الدفاع الجديد لحماية العقول. الخطر لا يتعلق فقط بتسريب المعلومات، بل بالتلاعب بالأفكار وتوجيهها. إن المعركة القادمة ليست رقمية فحسب، بل تتعلق بالوعي البشري، لذا يجب توسيع سياسات الأمن السيبراني لتشمل الدفاع عن العقل وتعزيز الوعي النقدي. علينا تدريب الأجيال القادمة على التمييز بين الحقائق والتضليل.

ختامًا، كشف اللواء عطية أن الذكاء الاصطناعي يحمل فرصًا هائلة للبشرية لكنه في الوقت نفسه يحمل تهديدات خفية تتعلق بحقوقنا الأساسية، مثل العقل والحرية الفكرية. لذا يجب أن يكون الهدف اليوم هو استخدام الذكاء الاصطناعي بحذر للحفاظ على دوره كخادم للإنسان، وليس كموجّه له.

عدد المصادر التي تم تحليلها: 0

المصدر الرئيسي : القاهرة – محمد مخلوف ![]()

معرف النشر: MISC-141125-191