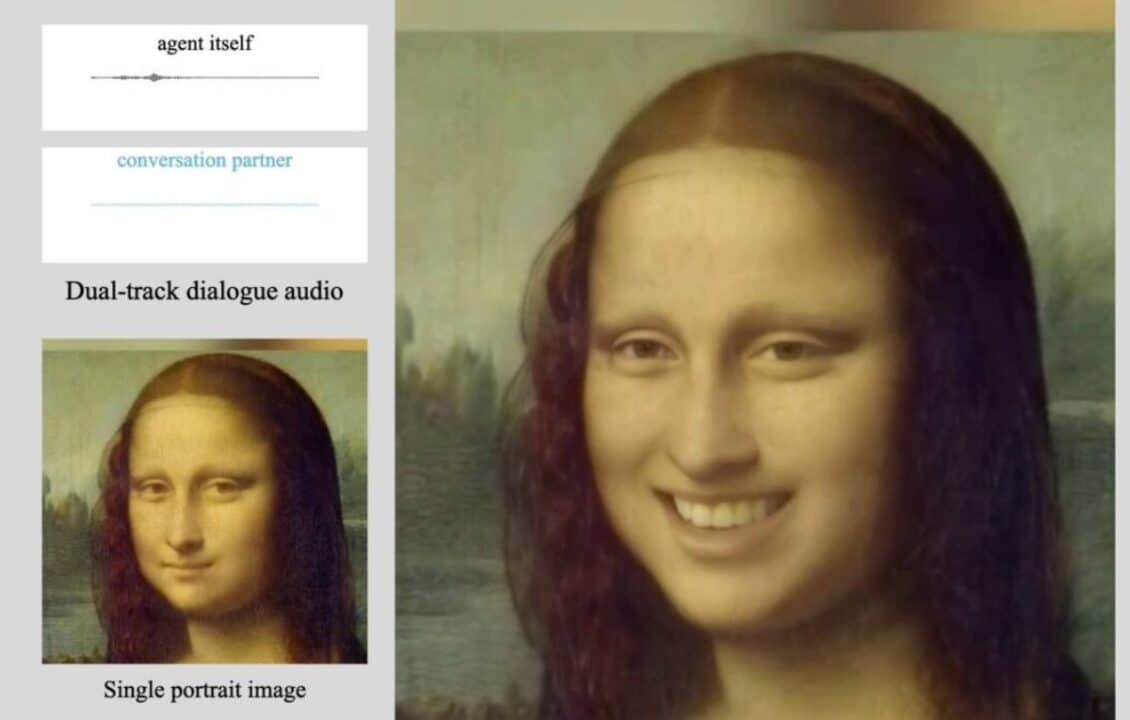

كشفت شركة بايت دانس، المالكة لتطبيق تيك توك، عن نموذج ذكاء اصطناعي جديد يسمى INFP، الذي يمكنه تحويل الصور الثابتة إلى مقاطع فيديو تفاعلية. يعتمد هذا النموذج على تقنية تحليل تدفق المحادثات، مما يتيح له إنشاء فيديوهات لمحادثات طبيعية بين شخصين دون الحاجة لتحديد أدوار المتحدثين يدوياً.

يتكون نموذج INFP من مرحلتين رئيسيتين. المرحلة الأولى تركز على تقليد حركات الرأس، حيث يتم التقاط تفاصيل تعابير الوجه وحركات الرأس من مقاطع فيديو ثم تحويلها إلى بيانات لتحريك الصور الثابتة. في المرحلة الثانية، يقوم النظام بتحليل الصوت لإنشاء حركات طبيعية تتماشى مع الكلام.

بوضع دقة عالية في الاعتبار، طورت بايت دانس قاعدة بيانات جديدة تحمل اسم DyConv، تحتوي على أكثر من 200 ساعة من محادثات حقيقية، وتتميز هذه القاعدة بقدرتها على التقاط نطاق واسع من المشاعر الإنسانية بجودة فيديو تفوق غيرها.

تشير بايت دانس إلى أن نموذج INFP يتفوق في مجالات مثل مطابقة حركة الشفاه بالصوت والحفاظ على ملامح الوجه الطبيعية، مما يضفي طابعًا أكثر واقعية لحركات الشخص المستمع. بينما يعتمد النظام حاليًا على الصوت، فإن الشركة تخطط لتوسيع قدراته للتعامل مع النصوص والصور وتحريك الجسم بالكامل.

ومع إدراكها لمخاطر إساءة الاستخدام، تخطط بايت دانس لتقييد استخدام هذه التقنية لمجالات البحث الأكاديمية في المرحلة الحالية. يُعتبر هذا النظام جزءًا من استراتيجية الذكاء الاصطناعي الأوسع للشركة، مع إمكانية استخدامه في تطبيقات مثل تيك توك وCapCut.

عدد المصادر التي تم تحليلها: 2

المصدر الرئيسي : aitnews.com محمد فارس

post-id: 28a70b17-9794-4a0f-9e12-12de415738e4