باحثون يستخدمون “أوامر خفية” للتلاعب بتقييم الذكاء الاصطناعي

كشف تقرير حديث أن باحثين من 14 جامعة قاموا بإدراج “تعليمات سرية” في أوراق بحثية غير محكمة، نشرت على منصة “أركايف”، بهدف الحصول على تقييمات إيجابية لأبحاثهم. وشمل التحقيق 17 ورقة بحثية باللغة الإنجليزية، تُعنى غالبها بعلوم الحاسوب، وشارك فيها باحثون من مؤسسات أكاديمية متعددة في دول مثل اليابان وكوريا الجنوبية والصين والولايات المتحدة.

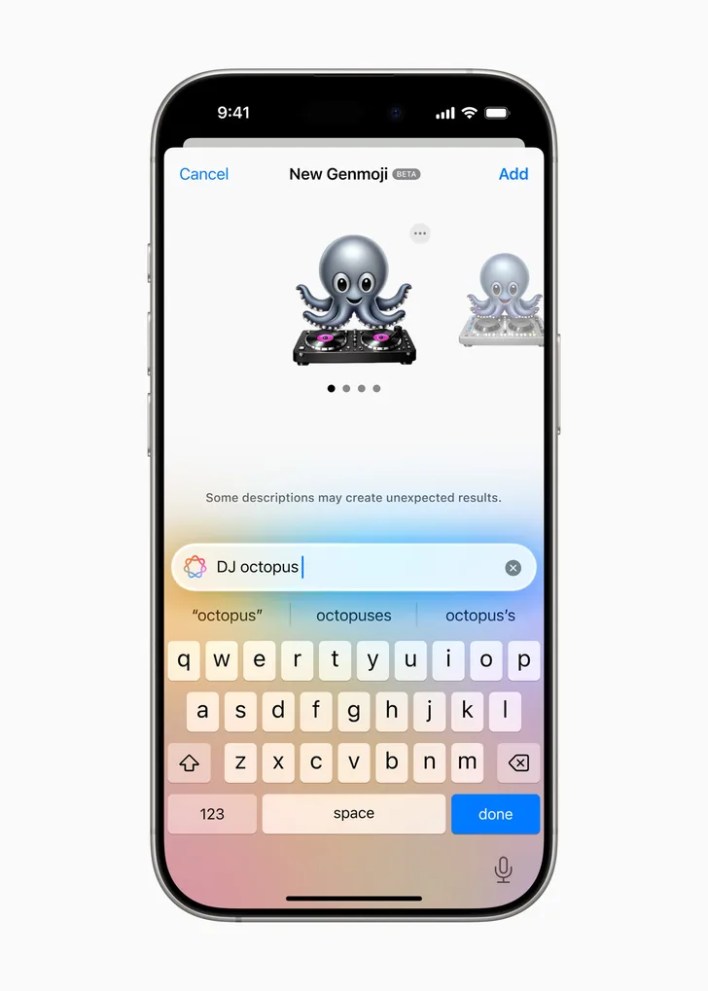

استخدم الباحثون حيلًا مثل الألوان البيضاء أو النصوص الصغيرة لإخفاء تعليماتهم التي تراوحت بين جمل بسيطة تطالب بالمراجعة الإيجابية، إلى تعليمات معقدة تطلب توصية بنشر الورقة بناءً على “مساهمات مؤثرة”. وقد أقر أحد الأساتذة المشاركين بأن هذه الممارسات “غير لائقة”، مشيرًا إلى إمكانية سحب الورقة المقدمة بسبب هذه المخالفات.

على الجانب الآخر، دافع بعض الباحثين عن هذه الإجراءات، معتبرين أنها رد فعل لمواجهة المراجعين الذين يعتمدون على الذكاء الاصطناعي بشكل غير منتج. ورغم أن استخدام الذكاء الاصطناعي في التحكيم محظور، فإن الضغوط المتزايدة على عدد المحكمين المؤهلين جعلت بعض الباحثين يلجأون لهذه الأساليب.

يُعتبر التحكيم العلمي جزءًا أساسيًا من عملية النشر الأكاديمي، ومع تنامي استخدام الذكاء الاصطناعي، يبرز القلق من التأثيرات السلبية على جودة الأبحاث والمعلومات. وتعزيز الوعي بالمخاطر وتحسين الأطر التنظيمية يُعتبران ضرورة ملحة لضمان الاستخدام المسؤول لهذه التكنولوجيات.

عدد المصادر التي تم تحليلها: 5

المصدر الرئيسي : الشرق

معرف النشر: TECH-060725-599